Et si le plus grand risque des lunettes connectées n’était pas l’innovation… mais la démo en direct ?

Lors de Meta Connect 2025, deux démonstrations sur scène ont déraillé autour des Ray-Ban Meta et des Meta Ray-Ban Display. L’incident, devenu viral, rappelle une vérité simple : en XR, la fiabilité en conditions réelles fait loi.

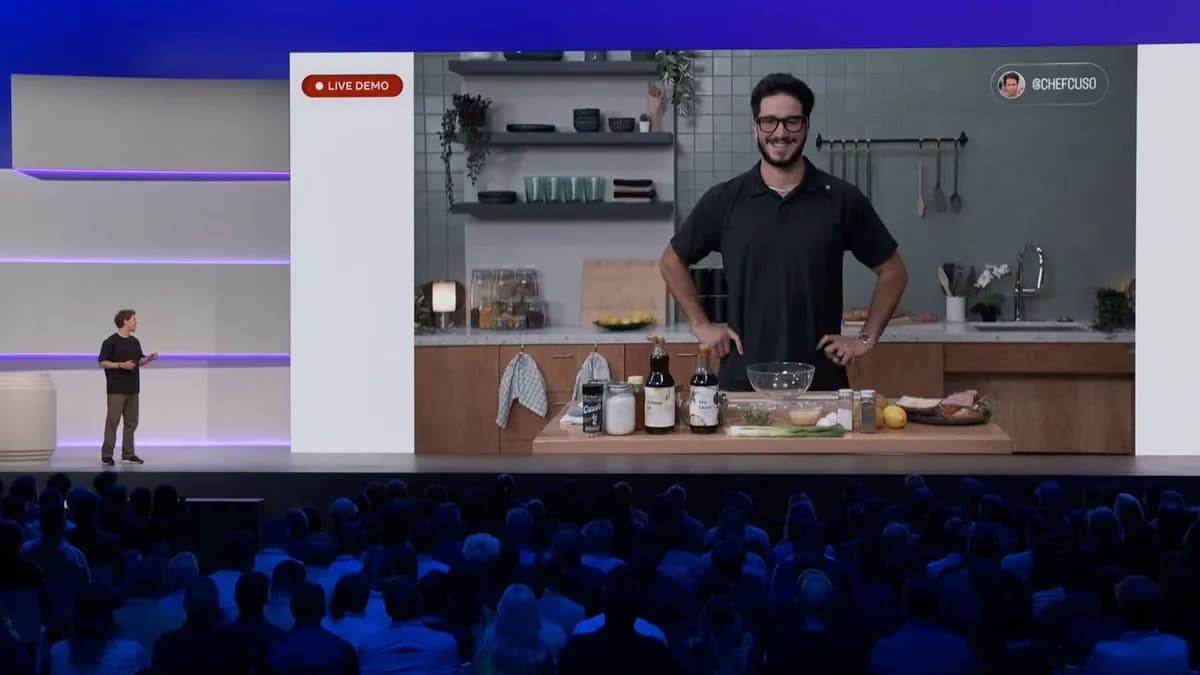

Ce qui s’est passé pendant la démo « Live AI »

Meta voulait illustrer « Live AI », une fonction où l’assistant Meta AI tourne en continu. Un chef et créateur culinaire devait préparer une sauce guidé par la voix, via la commande « Hey Meta ».

La scène a rapidement tourné à l’embarras. L’assistant n’a pas suivi le rythme et la démo s’est désorganisée, au point de devenir difficile à rattraper en direct.

Le fond du problème n’était pas seulement un moment de flottement humain. La commande d’activation a déclenché Meta AI sur toutes les paires de lunettes à portée de voix dans la salle.

- Le « wake word » (mot d’activation) « Hey Meta » a été entendu par de nombreux appareils

- Plusieurs lunettes ont tenté de se connecter et de solliciter l’IA en même temps

- Les serveurs ont subi une surcharge assimilée à un DDoS auto-infligé

Jake Steineman (Reality Labs) l’a expliqué publiquement : l’activation simultanée a « effectivement DDoS nos serveurs ». Une panne spectaculaire, mais aussi étonnamment prévisible.

Le phénomène n’est pas nouveau. Les enceintes vocales ont déjà vécu ce scénario lorsqu’une publicité TV prononce « Hey Google » ou « Hey Alexa » et réveille des appareils dans tout un salon.

- Un mot d’activation est pratique, mais difficile à isoler en environnement dense

- Plus il y a d’appareils, plus l’effet de multiplication est brutal

- Le direct transforme un détail en incident mondialement visible

Pourquoi c’était « prévisible »… mais quand même surprenant

L’article source souligne un point ironique : il fallait beaucoup d’appareils Meta à portée pour provoquer une telle surcharge. Meta AI n’est pas un assistant « partout » comme Siri ou Gemini sur smartphone.

Par défaut, Meta AI vit surtout dans les lunettes Ray-Ban Meta et Oakley Meta. Et sur Quest si l’utilisateur choisit d’activer l’option. D’où l’image d’une salle très équipée en produits Meta.

- La densité d’appareils a amplifié l’erreur de design du déclenchement vocal

- La démonstration a révélé un risque « flotte » (beaucoup d’unités au même endroit)

- Le cloud devient un point de fragilité quand tout le monde appelle en même temps

Rappel utile : AR superpose des informations au monde réel. XR regroupe VR, AR et MR, où réel et virtuel cohabitent plus finement.

Deuxième échec : l’appel WhatsApp sur Meta Ray-Ban Display

La seconde démonstration visait un usage simple : un appel vidéo WhatsApp entre Mark Zuckerberg et Andrew Bosworth, chacun avec des Meta Ray-Ban Display, annoncées aux États-Unis à 799 dollars.

L’appel n’a pas abouti sur scène. Après plusieurs tentatives, Bosworth est finalement venu sur scène pour simuler rapidement ce que l’expérience aurait dû être.

Ces démos « connectées » sont connues pour mal vieillir en keynote. Une salle pleine signifie une pression énorme sur le Wi‑Fi et les réseaux mobiles, avec plusieurs appareils par personne.

- Les conditions radio d’un événement ne ressemblent pas à un labo

- Les interférences et congestions créent des comportements imprévisibles

- Une fonctionnalité « banale » devient risquée dès qu’elle dépend du réseau

L’article note aussi ce que Zuckerberg n’a pas fait : demander au public de couper le Wi‑Fi, comme Steve Jobs l’avait fait lors d’un incident de connexion en 2010.

Le vrai sujet : la robustesse opérationnelle, pas la « magie »

Ces ratés ne disent pas seulement « la démo était mal préparée ». Ils exposent des contraintes structurelles des dispositifs XR et des lunettes connectées.

Dès qu’un service dépend du cloud, il dépend aussi de la latence, de la bande passante, de l’authentification et de la disponibilité serveur. En keynote, tout est sous stress maximal.

- Un assistant IA (LLM) implique des requêtes réseau fréquentes

- Une activation simultanée peut créer un pic ingérable

- Une expérience « continue » (Live AI) augmente la sensibilité à la charge

Un LLM (large language model) est un modèle de langage capable de générer et comprendre du texte. Dans des lunettes, il est souvent piloté par la voix et alimenté par la caméra… donc fortement dépendant du traitement distant.

Imaginez… un salon où tout le monde dit « Hey Meta »

Imaginez une activation de marque en retail, avec 30 paires de lunettes en démonstration et des visiteurs qui répètent la phrase d’activation « pour essayer ». En quelques secondes, tous les appareils sollicitent le même service.

- L’expérience devient lente ou se bloque

- Les équipes terrain perdent la main

- La crédibilité de l’innovation s’effondre devant le public

Le problème n’est pas l’IA en soi. C’est l’effet « foule + simultanéité + dépendance réseau », exactement ce que les événements professionnels concentrent.

Imaginez… une formation critique sur site industriel

Imaginez une formation sécurité en VR dans un bâtiment où le réseau est instable. Si un module s’appuie sur des services cloud au mauvais moment, la session s’interrompt.

- Les apprenants décrochent

- Le formateur improvise, perd le timing

- La session devient plus coûteuse et moins fiable qu’un support classique

Pour les professionnels formation, industrie, santé ou événementiel, la question n’est pas « est-ce impressionnant ? ». C’est « est-ce que ça tient en production, partout ? ».

Enseignements concrets pour les projets XR en entreprise

Le cas Meta illustre des points de vigilance applicables à toute stratégie XR, qu’il s’agisse de VR, d’AR ou de MR.

- Penser « densité » : combien d’appareils simultanés dans un même lieu ?

- Tester en conditions dégradées : réseau faible, latence, interférences

- Prévoir un mode autonome : contenu local, scénarios sans cloud

- Encadrer le vocal : éviter les wake words génériques en environnement public

- Orchestrer la flotte : mises à jour, accès, profils, sessions, supervision

Le « hand tracking » (suivi des mains) et le « passthrough » (vidéo du monde réel dans un casque) sont souvent perçus comme des marqueurs de maturité. Mais l’exploitation terrain dépend d’abord de la stabilité.

Ce que cela change pour les démos, la formation et les événements

Une démo XR n’est pas une vidéo. C’est un système complet : appareils, réseau, services, scénarios, support. Le moindre maillon peut casser l’expérience.

- En événementiel : prévoir un réseau dédié ou un fonctionnement local

- En formation : sécuriser la répétabilité, session après session

- En santé : privilégier la continuité et la traçabilité plutôt que l’effet waouh

- En tourisme et commerce : garantir une expérience fluide en lieu ouvert

La leçon la plus dure : une panne en public ne dégrade pas seulement l’instant. Elle peut remettre en cause la confiance dans tout le projet.

Comment explorations360 intègre ces leçons sur le terrain

Chez explorations360, l’objectif est de livrer des expériences immersives qui tiennent en conditions réelles, pas seulement en environnement contrôlé.

Les valises easybox360 s’inscrivent dans cette logique : des casques VR préconfigurés, pensés pour des déploiements autonomes, avec un pilotage simple et maîtrisé sur site.

- Contenus embarqués localement pour limiter la dépendance au cloud

- Déploiement terrain facilité, avec une logique « prêt à l’emploi »

- Réduction des risques liés aux réseaux saturés en salon ou en séminaire

Pour industrialiser des parcours, easystory360 permet de structurer des expériences 360° et VR, avec une approche no-code adaptée aux équipes métiers.

- Scénariser des modules sans développement lourd

- Ajouter des étapes, médias et interactions de manière itérative

- Intégrer des quiz VR pour renforcer l’évaluation et l’engagement

Côté diffusion, easykiosk360 répond aux besoins de consultation en espace public ou showroom, avec une expérience cadrée, utile quand l’environnement est bruyant et dense.

Et pour les organisations qui cherchent à relier l’immersif à leurs parcours, l’intégration à un LMS (Learning Management System) devient un levier clé pour suivre la progression et standardiser les sessions.

Enfin, sur les usages sensibles, easycare360 s’inscrit dans une approche orientée accompagnement et clarté d’usage, où la stabilité et la simplicité priment sur la surenchère technique.

Au-delà du « demo fail », un signal pour toute l’industrie XR

Meta a montré, malgré elle, que le passage à l’échelle ne se joue pas seulement sur le hardware. Il se joue sur l’architecture, l’orchestration et la résilience.

Quand une simple phrase peut réveiller une salle entière d’appareils et saturer un service, c’est un rappel : les usages XR modernes sont des systèmes distribués, donc fragiles sans garde-fous.

#MetaConnect #RayBanMeta #XR #RéalitéAugmentée #RéalitéVirtuelle #Événementiel #FormationProfessionnelle

Cet article fait partie de notre veille technologique Veille360, une sélection d'actualités sur les technologies immersives.