Quand on parle de réalité augmentée ou de lunettes connectées, on pense souvent d’abord à l’écran, à la caméra ou à l’intelligence artificielle. Pourtant, un autre sujet est tout aussi décisif : comment contrôler l’appareil, simplement, discrètement et sans sortir son téléphone à chaque action ? C’est précisément là que Meta envoie un signal fort en finançant six études externes autour de la sEMG, pour surface electromyography, appliquée à un contrôleur porté au poignet.

Dit autrement, Meta ne cherche pas seulement à afficher des informations devant les yeux. L’entreprise cherche aussi à rendre l’interaction plus naturelle. Un peu comme passer d’une télécommande pleine de boutons à un geste presque invisible. Pour un public non spécialiste, c’est un sujet clé, car la réussite des futurs wearables ne dépendra pas seulement de la qualité d’affichage, mais de la facilité avec laquelle on pourra les utiliser au quotidien.

L’annonce est concrète. Meta a retenu six équipes universitaires parmi 70 candidatures mondiales. Chaque groupe recevra 150 000 dollars. Les universités sélectionnées sont la University of Central Florida, la University of South Florida, la University of California, Davis, Newcastle University, la University of British Columbia et Northwestern University. Ce n’est pas un simple exercice académique. Cela montre que Meta considère cette technologie comme suffisamment sérieuse pour devenir un mode d’entrée central dans ses futurs produits.

Une interface qui lit les signaux du poignet

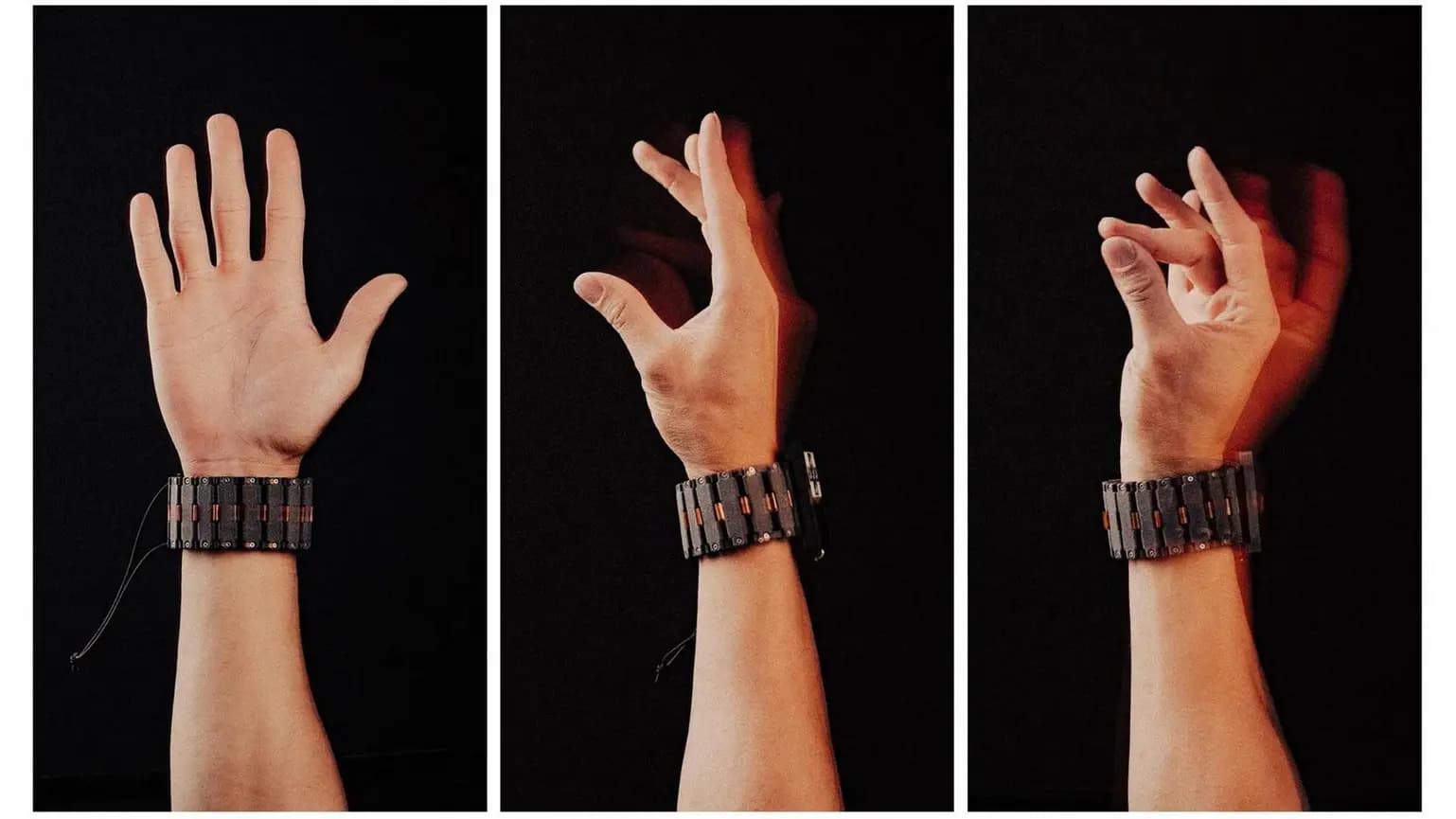

La sEMG, ou électromyographie de surface, capte l’activité électrique des muscles au niveau du poignet et de la main. Ensuite, ces signaux sont traduits en commandes numériques. L’idée peut sembler futuriste, mais le principe est assez simple à comprendre. Avant même qu’un mouvement soit visible, le corps émet déjà des signaux électriques. Le bracelet vient écouter ces signaux, un peu comme un micro capte une voix avant qu’elle soit amplifiée.

Dans le cas de Meta, cette interface neuronale portée au poignet est pensée comme le principal dispositif d’entrée pour les Meta Ray-Ban Display. Ces lunettes intelligentes, lancées en septembre dernier, sont les premières de la marque à intégrer un écran. Elles sont affichées à 800 dollars et ne sont, pour le moment, disponibles qu’aux États-Unis. Elles utilisent le même schéma d’interaction que celui montré auparavant avec le prototype Orion AR, révélé fin 2024.

Ce point est important. Meta ne finance pas ces recherches dans le vide. L’entreprise a déjà un produit commercial, les Meta Ray-Ban Display, et une trajectoire produit plus large avec Orion AR. En clair, la sEMG n’est plus seulement une piste de laboratoire. Elle devient une pièce potentielle de l’expérience utilisateur dans l’informatique spatiale de demain.

Le vrai défi n’est pas seulement technique

Quand une nouvelle interface apparaît, la première question n’est pas toujours : est-ce que ça marche ? La vraie question est souvent : est-ce que les gens vont comprendre comment s’en servir ? Meta le dit très clairement. Les études financées doivent aider à répondre à deux questions majeures : comment les utilisateurs apprennent-ils de nouveaux contrôles basés sur la sEMG, et comment simplifier l’onboarding ?

C’est un enjeu souvent sous-estimé. Une technologie peut être brillante sur le papier et échouer si ses gestes sont difficiles à mémoriser. C’est un peu comme apprendre un nouvel instrument. Si les premières minutes sont frustrantes, beaucoup abandonnent. Les chercheurs vont donc comparer différentes méthodes d’apprentissage, par exemple un entraînement gamifié face à un apprentissage pas à pas plus classique.

D’autres projets cherchent à rendre le système plus intelligent face aux différences individuelles. Car nous n’avons pas tous les mêmes signaux musculaires, les mêmes habitudes motrices ni la même précision gestuelle. Une bonne interface devra donc s’adapter à l’utilisateur au fil du temps, et non l’inverse. Dans le monde professionnel, c’est crucial. Une solution immersive utile n’est pas celle qui impressionne pendant une démonstration, c’est celle qui reste simple pour des centaines de personnes aux profils variés.

Vers des commandes plus riches et plus discrètes

L’autre enjeu, c’est ce que Meta appelle en creux la bande passante de communication. Autrement dit, combien d’ordres différents peut-on envoyer à un appareil sans rendre les gestes compliqués ou fatigants ? Aujourd’hui, beaucoup d’interfaces gestuelles sont limitées. Elles fonctionnent bien pour quelques actions simples, mais deviennent vite lourdes dès qu’il faut enchaîner plusieurs commandes.

Les recherches financées veulent aller plus loin. Certaines visent à permettre des interactions plus complexes sans perturber les mouvements naturels de la main. C’est fondamental pour des lunettes AR ou des wearables utilisés dans la rue, en magasin ou au travail. Personne n’a envie de faire de grands gestes visibles pour changer un menu, valider une action ou naviguer dans une information contextuelle.

Parmi les pistes les plus intrigantes, on trouve aussi la génération de parole silencieuse. Le principe consiste à traduire des signaux musculaires en voix synthétisée. Dit simplement, une personne pourrait potentiellement communiquer sans parler à voix haute, grâce à l’activité musculaire captée puis convertie par le système. Nous en sommes encore au stade de la recherche, mais on voit immédiatement l’intérêt dans des contextes où la discrétion, le bruit ambiant ou certaines limitations physiques jouent un rôle important.

On comprend ainsi pourquoi Meta affiche sa confiance. Financer ces travaux, juste après le lancement des Meta Ray-Ban Display, suggère que l’entreprise considère la sEMG comme un mode de contrôle crédible pour de futurs appareils, probablement AR. Les prochains résultats pourraient d’ailleurs émerger dans le cadre de SIGGRAPH, organisé cette année à Los Angeles du 19 au 23 juillet, un rendez-vous souvent riche en publications sur les interfaces immersives.

Des usages très concrets, bien au-delà du gadget

Le plus intéressant dans cette annonce, c’est que les applications ne se limitent pas aux lunettes connectées grand public. Plusieurs sujets de recherche portent sur des usages assistifs.

Dans la santé, la sEMG pourrait aider des survivants d’AVC à retrouver un meilleur contrôle musculaire. Là encore, l’image la plus simple est celle d’un système qui apprend avec la personne, comme un coach patient qui ajuste ses exercices selon les progrès réels. D’autres travaux explorent l’amélioration du pilotage des prothèses grâce à des systèmes co-adaptatifs. Cela signifie que l’utilisateur apprend à utiliser l’outil, mais que l’outil apprend aussi à mieux comprendre l’utilisateur.

En formation professionnelle, on peut imaginer des interfaces plus fluides pour manipuler un contenu immersif sans manette classique. Dans l’industrie, un technicien portant des lunettes pourrait afficher une procédure, valider une étape ou appeler une aide contextuelle par des micro-gestes du poignet, tout en gardant les mains disponibles. Dans le commerce, un vendeur équipé de lunettes connectées pourrait consulter une fiche produit ou un stock sans casser la relation client en regardant un terminal. Dans le tourisme ou la culture, des visiteurs pourraient naviguer dans un parcours augmenté de façon plus naturelle, sans avoir à sortir un smartphone à chaque interaction.

Le point commun de tous ces cas d’usage est simple : plus l’interface s’efface, plus l’expérience gagne en fluidité. Et c’est souvent cette discrétion qui transforme une innovation intéressante en usage réellement adopté.

Le précédent Myo, ou pourquoi la sEMG n'est pas un sujet neuf

Pour ceux qui suivent les interfaces immersives depuis plus d'une décennie, l'annonce de Meta provoque un drôle d'écho. Entre 2014 et 2015, la startup canadienne Thalmic Labs commercialisait le Myo, un brassard sEMG porté à l'avant-bras. Huit capteurs électromyographiques, une centrale inertielle 9 axes, une connexion Bluetooth LE, le tout pour 199 dollars. Chez explorations360, nous l'avons testé à cette époque, précisément pour explorer le pilotage gestuel d'expériences immersives. Le constat était fascinant et frustrant à la fois : la reconnaissance de gestes fonctionnait, la latence était acceptable, mais la fiabilité restait trop fragile pour un usage professionnel récurrent. Le calibrage variait d'un utilisateur à l'autre, la fatigue musculaire faussait les signaux, et l'écosystème logiciel manquait de maturité.

Thalmic Labs a fini par pivoter, abandonnant le Myo pour se renommer North et développer des lunettes connectées, les Focals. Google a racheté North en 2020 pour environ 180 millions de dollars, mettant fin au projet lunettes et absorbant les brevets. Le Myo, lui, est devenu un objet de collection pour passionnés d'interfaces alternatives. Le nôtre trône désormais sur notre étagère « musée » de la VR, aux côtés d'autres pionniers qui ont ouvert la voie sans jamais atteindre le grand public.

Ce qui frappe, c'est le décalage temporel. Plus de dix ans séparent les premiers tests grand public de sEMG avec le Myo et l'annonce actuelle de Meta. Dix ans pendant lesquels la technologie de base, capter l'activité électrique des muscles pour la traduire en commandes, n'a pas fondamentalement changé de principe. Ce qui a changé, c'est la puissance de calcul embarquée, les modèles de machine learning capables d'interpréter les signaux en temps réel, et surtout le contexte produit. En 2014, le Myo cherchait un usage. En 2026, Meta a d'abord construit l'usage, les lunettes, l'écosystème, la base installée, puis cherche l'interface qui manque.

Cette chronologie dit quelque chose de profond sur la VR et ses interfaces. Le temps entre l'invention d'un outil et son adoption réelle est presque toujours plus long que ce qu'imaginent les ingénieurs et les investisseurs. La manette VR elle-même a mis des années à se stabiliser. Le hand tracking, annoncé comme révolutionnaire dès 2016, n'est devenu fiable qu'en 2023-2024. Le eye tracking suit le même chemin. Et la sEMG, malgré le Myo en 2014, n'arrive peut-être à maturité commerciale qu'en 2026-2027.

Pour les professionnels qui déploient des projets immersifs, cette observation est stratégique. Il ne faut ni ignorer les signaux faibles, le Myo en était un, ni tout miser sur une technologie avant que l'écosystème ne soit prêt. La bonne posture consiste à surveiller, tester quand c'est accessible, mais construire ses projets sur des interfaces déjà stabilisées. C'est exactement ce que permet une plateforme comme easystory360 : créer des expériences qui fonctionnent aujourd'hui sur les interfaces disponibles, tout en restant prêtes à intégrer les modes d'interaction de demain quand ils auront fait leurs preuves.

Ce que les entreprises doivent retenir dès maintenant

Même si ces six études sont encore en cours, le mouvement est clair. Le marché des technologies immersives entre dans une phase où la qualité de l’interaction compte autant que la qualité des contenus. Pour les entreprises, cela change la lecture du sujet. Il ne suffit plus de demander si la VR ou l’AR est impressionnante. Il faut demander si elle est facile à prendre en main, inclusive et compatible avec des usages répétés.

Si une organisation veut se préparer, elle peut déjà observer plusieurs indicateurs très concrets :

- le temps nécessaire pour comprendre une interface

- le taux d’erreur lors des premières utilisations

- la fatigue gestuelle après plusieurs minutes

- la capacité du système à s’adapter à des profils différents

- la discrétion d’usage dans un contexte réel

Si ces données manquent, la bonne méthode consiste à lancer des tests utilisateurs courts, sur le terrain, avec des profils variés. C’est souvent plus utile qu’une démonstration très technologique menée dans des conditions idéales.

Cette logique fait écho à des déploiements déjà visibles dans l’écosystème immersif. Chez explorations360, la valeur vient justement d’expériences pensées pour être accessibles et utiles dans des contextes sensibles. C’est le cas de easycare360, déployé au Centre Hospitalier Saint-Helier, à Rennes, pour l’habituation aux soins en réalité virtuelle auprès de patients anxieux. Le témoignage est parlant : "L'outil nous permet de réduire significativement l'anxiété des patients." Le lien avec la sEMG est naturel. Dans les deux cas, on parle d’interfaces et d’expériences qui cherchent à être plus douces, plus discrètes et plus assistives, afin de mieux s’adapter à l’humain plutôt que de lui imposer une technologie complexe.

Au fond, c’est peut-être cela la vraie maturité des technologies immersives. Non pas multiplier les effets spectaculaires, mais réduire la friction. Si Meta confirme, avec les travaux de la University of Central Florida, de la University of South Florida, de la University of California, Davis, de Newcastle University, de la University of British Columbia et de Northwestern University, que la sEMG peut devenir un contrôle fiable et simple, alors les wearables feront un pas important vers un usage quotidien plus naturel.

L’article original est disponible ici : https://www.roadtovr.com/meta-emg-input-wearables-research-grant/

#sEMG, #InnovationTechnologique, #LunettesIntelligentes, #RéalitéAugmentée, #InteractionNaturelle

Cet article fait partie de notre veille technologique Veille360, une sélection d'actualités sur les technologies immersives.